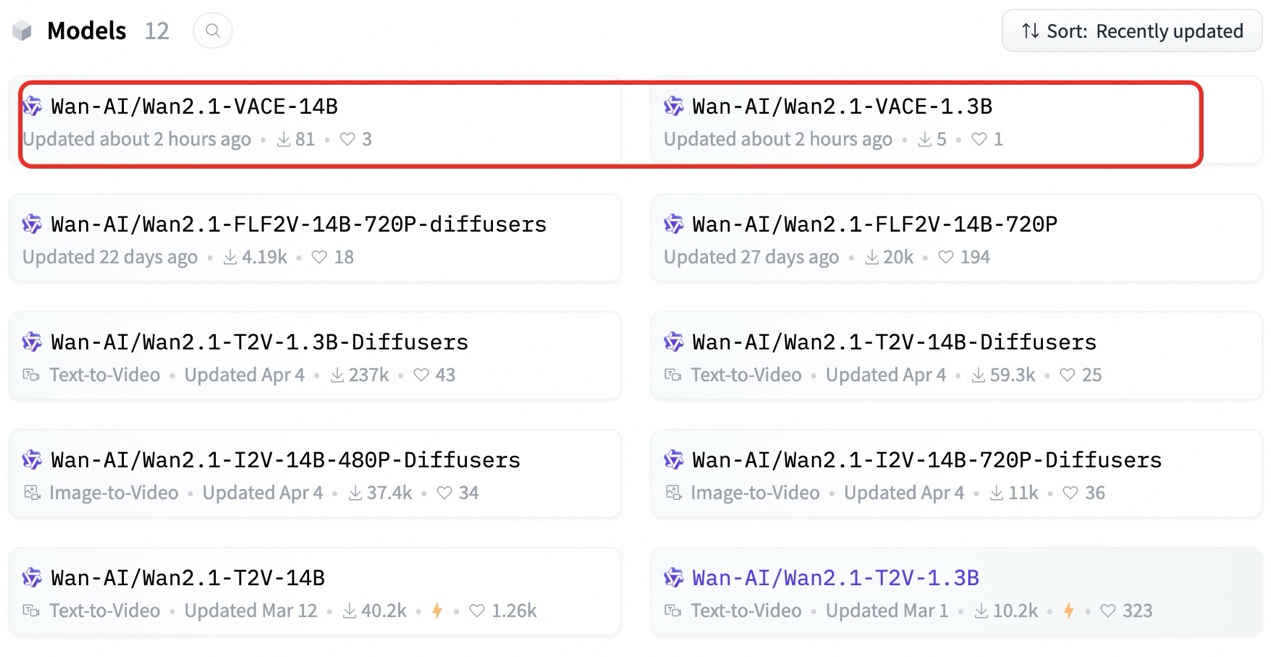

新京报贝壳财经讯(记者罗亦丹)5月14日晚,阿里巴巴正式开源通义万相Wan2.1-VACE,这是业界功能最全的视频生成与编辑模型,单一模型可同时支持文生视频、图像参考视频生成、视频重绘、视频局部编辑、视频背景延展以及视频时长延展等全系列基础生成和编辑能力。本次共开源1.3B和14B两个版本,其中1.3B版本可在消费级显卡运行,开发者可在GitHub、Huggingface及魔搭社区下载体验。该模型还将逐步在通义万相官网和阿里云百炼上线。

据介绍,Wan2.1-VACE基于通义万相文生视频模型研发,同时创新性提出了全新的视频条件单元VCU,它在输入形态上统一了文生视频、参考图生视频、视频生视频,基于局部区域的视频生视频4大类视频生成和编辑任务;同时,Wan2.1-VACE还进一步解决了多模态输入的token序列化难题,将VCU输入的帧序列进行概念解耦,分开重构成可变序列和不可变序列后进行编码。

Wan2.1-VACE支持全部主流输入形式,涵盖文本、图像、视频、Mask和控制信号,可以实现角色一致性、布局、运动姿态和幅度等要素的控制。例如,Wan2.1-VACE可以基于物体参考图或者视频帧生成一段视频,也可以通过抹除、局部扩展等操作,对原有视频进行重新生成,该模型还可以通过深度图、光流、布局、灰度、线稿等控制信号对视频进行编辑。

Wan2.1-VACE还支持任意基础能力的自由组合,用户无需针对特定功能训练一个新的专家模型,即可完成更复杂的任务,极大地扩展了AI视频生成的想象空间。例如,将图片参考和主体重塑功能组合,可以实现视频的物体替换;将图片参考、首帧参考、背景扩展和时长延展功能,可以将一张竖版图片变成横版视频,并且在其中加入参考图片中的元素。

编辑 陈莉 校对 杨利